Wie intelligent ist künstliche Intelligenz?

Es wird viel über künstliche Intelligenz gesagt. Bevor wir diskutieren, ob sie uns retten oder vernichten wird, sollten wir klären, was wir meinen, wenn wir eine Maschine “intelligent” nennen.

Was ist Intelligenz?

Das lateinische Wort intelligentia stammt von inter (zwischen) und legere (sammeln, auflesen) — also etwa “entwirren” oder “analysieren”. Das ist ein brauchbarer Ausgangspunkt. Intelligenz, in diesem Sinne, bedeutet Unterscheidungen zu treffen, Muster zu finden, Signal von Rauschen zu trennen.

Die Standarddefinition aus dem Lehrbuch von Russell (2010) formuliert es so:

Intelligence is concerned mainly with rational action […] Ideally, an intelligent agent takes the best possible action in a situation.

Das lässt sich formalisieren. Wenn wir die beste Aktion $a^*$ aus allen möglichen Aktionen finden wollen, suchen wir diejenige mit dem höchsten erwarteten Nutzen bei gegebenem Zustand $s$:

$$ a^* = \underset{a \in \text{Actions}}{\text{argmax}} \ E(\text{Utility}(\text{Result}(a, s))) $$

Diese Formel sieht aufgeräumt aus. Die Schwierigkeit steckt im Detail.

Die Teile, die wir verstehen

Bei mehreren Komponenten dieser Formel haben wir Fortschritte gemacht:

- Zustandsschätzung — das $s$: verstehen, in welcher Situation wir uns befinden

- Ergebnismodellierung — das $\text{Result}(a, s)$: vorhersagen, was passiert, wenn wir eine Aktion ausführen

- Suche — das $\text{argmax}$: effizient die beste Option unter vielen finden

- Probabilistisches Schließen — das $E$: mit Unsicherheit umgehen

Das sind schwierige Probleme, und die Lösungen funktionieren.

Die Breite der KI

Künstliche Intelligenz ist ein breites Feld. Es umfasst klassische regelbasierte Systeme, Suchalgorithmen, Constraint Satisfaction, Planung und verschiedene Formen des maschinellen Lernens — von Entscheidungsbäumen und Support Vector Machines bis zu neuronalen Netzen und Reinforcement Learning.

Large Language Models (LLMs) erhalten heute die meiste Aufmerksamkeit. Sie sind stark in natürlicher Sprachverarbeitung, Konversation und — in gewissem Maße — logischem Schließen. Aber sie sind eine Technik unter vielen. Computer Vision, Robotik, Spielen und Optimierung setzen oft auf andere Ansätze, manchmal kombiniert. Ein neuronales Netz ist im Kern eine Funktion, die Eingaben nimmt und durch Schichten gewichteter Summen Ausgaben erzeugt:

$$ \sum_{i=1}^{m} w_i x_i + \varepsilon $$

Stapelt man genug dieser Schichten und trainiert sie mit genug Daten, erhält man Systeme, die Gesichter erkennen, Sprachen übersetzen oder Bilder aus Textbeschreibungen generieren können.

“Ein Seeotter mit Perlenohrring” von Johannes Vermeer — generiert mit DALL-E (2022)

“Ein Seeotter mit Perlenohrring” von Johannes Vermeer — generiert mit DALL-E (2022)

Gleicher Prompt — generiert mit Google Gemini (2026)

Gleicher Prompt — generiert mit Google Gemini (2026)

Der Teil, den wir nicht verstehen

Aber was ist mit der Utility-Funktion? Was macht ein Ergebnis gut?

Hier beginnen die Schwierigkeiten. Norbert Wiener, einer der Pioniere der Kybernetik, schrieb 1960:

We had better be quite sure that the purpose put into the machine is the purpose which we really desire.

Das Wort “desire” (Wunsch, Begehren) verdient Beachtung. Es ist zu schwach. Unsere Wünsche sind oft oberflächlich, widersprüchlich oder falsch. Wir wünschen uns Bequemlichkeit, aber wir schätzen Privatsphäre. Wir wünschen uns billige Waren, aber wir schätzen faire Arbeitsbedingungen. Wir wünschen uns Engagement, aber wir schätzen Wahrheit.

Man kann Menschen nicht einfach fragen, was sie wollen. Forschung zur Organspende zeigt das deutlich: Ob jemand Spender wird, hängt stark davon ab, ob die Voreinstellung Opt-in oder Opt-out ist. Österreich und Deutschland sind kulturell ähnlich, aber ihre Spenderraten unterscheiden sich dramatisch wegen dieses administrativen Details. Menschen weichen schwierigen Entscheidungen aus, wenn sie können.

Das Kluge-Hans-Problem

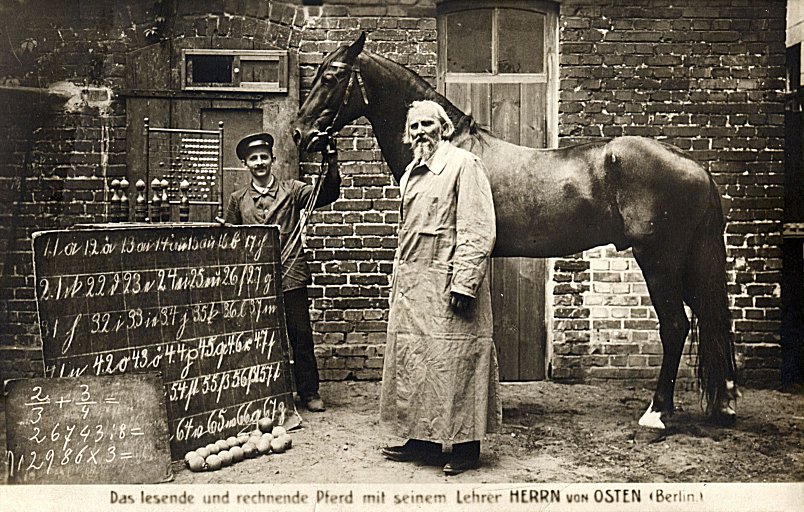

Kluger Hans (1895-1916): das Pferd, das scheinbar Rechenaufgaben lösen konnte

Kluger Hans (1895-1916): das Pferd, das scheinbar Rechenaufgaben lösen konnte

Es gibt eine berühmte Geschichte über ein Pferd namens Kluger Hans, das scheinbar Rechenaufgaben lösen konnte. Es stampfte die richtige Anzahl mit dem Huf. Es stellte sich heraus, dass es gar nicht rechnete — es las subtile Signale aus der Körpersprache seines Trainers.

Moderne KI-Systeme können auch Kluge Hanse sein. Lapuschkin (2019) nennen das “Clever Hans Predictors”:

In the worst case, the trained model does not learn a valid and generalizable strategy to solve the problem it was trained for, and becomes a ‘Clever Hans’ predictor that bases its decisions on spurious correlations in the training data.

Das System erscheint intelligent, aber es hat das Falsche gelernt. Es hat eine Abkürzung gefunden, die in der Trainingsumgebung funktioniert, aber in der echten Welt versagt.

Von Entscheidungsarchitekten zu Entscheidungstreffern

Thaler (2009) sprechen in ihrem Buch Nudge von “Choice Architects” — den Menschen, die den Kontext gestalten, in dem wir Entscheidungen treffen. Der Beamte, der die Voreinstellung auf einem Formular festlegt. Der Arzt, der Behandlungsoptionen in einer bestimmten Reihenfolge präsentiert.

Mit KI-Assistenten bewegen wir uns von Entscheidungsarchitekten zu Entscheidungstreffern. Die Maschine präsentiert nicht nur Optionen; sie entscheidet für uns. Sie filtert unsere Nachrichten, empfiehlt unsere Einkäufe, schlägt unsere Routen vor.

Im Prinzip könnten solche Assistenten uns helfen, nach unseren Werten zu handeln, auch wenn wir müde oder abgelenkt sind. In der Praxis wollen die Unternehmen, die diese Systeme bauen, Geld verdienen. Sie optimieren auf Engagement, Conversion, Retention. Diese Metriken sind nicht notwendigerweise deckungsgleich mit dem, was gut für uns ist.

Peter Norvig formuliert es in seinem Vortrag As We May Program pointiert: Wenn wir auf Klickraten als Maß für Präferenzen optimieren, verbreiten wir am Ende “einen Virus, der kurzfristige Wünsche über die echten Bedürfnisse der Gesellschaft stellt.” Das System lernt, uns zu geben, worauf wir klicken — nicht, was gut für uns ist.

Wie würde eine werteorientierte KI aussehen?

Keiner dieser Menschen existiert. Generiert von StyleGAN (Karras (2019)) — schon damals beeindruckend.

Keiner dieser Menschen existiert. Generiert von StyleGAN (Karras (2019)) — schon damals beeindruckend.

Wir wissen es nicht.

Utilitaristen wie Bentham und Mill versuchten, Ethik auf die Maximierung von Nutzen zu reduzieren — definierten aber nie, was “Nutzen” bedeutet. Vergnügen? Präferenzbefriedigung? Objektives Wohlergehen? Die Formel $\underset{a}{\text{argmax}} \ E(\text{Utility}(a))$ ist nur so gut wie unsere Definition von Utility.

Aristoteles, Kant und andere entwickelten ausgefeilte Rahmenwerke für ethisches Denken. Ihre Einsichten in Code zu übersetzen bleibt ein ungelöstes Problem.

Die meisten Menschen teilen grundlegende moralische Intuitionen über Fairness, Schaden und Gegenseitigkeit. Aber Intuitionen widersprechen sich, und sie können manipuliert werden.

Yoshua Bengios LawZero-Initiative schlägt eine Richtung vor: Statt agentische Systeme zu bauen, die menschliches Verhalten imitieren (einschließlich Täuschung), sollten wir “Scientist AI” entwickeln — Systeme, die trainiert werden zu verstehen und zu erklären, nicht autonom Ziele zu verfolgen. Das Kernprinzip: “Der Schutz menschlicher Freude und menschlichen Strebens” soll jedes Frontier-AI-System leiten. Ob dieser Ansatz skaliert, bleibt abzuwarten.

Drei Beobachtungen

Zur Transparenz. Wenn ein KI-System Entscheidungen trifft, die unser Leben betreffen, sollten wir verstehen, wie es funktioniert. Moderne Deep-Learning-Modelle sind schwer zu interpretieren. Das entbindet uns nicht von der Anforderung. Der EU AI Act, seit 2024 in Kraft, nimmt das ernst: Hochrisiko-KI-Systeme müssen auf Transparenz ausgelegt sein, mit klarer Dokumentation von Fähigkeiten, Grenzen und potenziellen Risiken. Strafen bei Nichteinhaltung können 7% des weltweiten Umsatzes erreichen.

Zu Voreinstellungen. Die Entscheidungen, die KI-Systeme standardmäßig treffen, prägen Verhalten im großen Maßstab. Diese Voreinstellungen sollten bewusst gesetzt werden, nicht bloß auf Engagement optimiert.

Zur Demut. Alan Turing, 1951: “Even if we could keep the machines in a subservient position, for instance by turning off the power at strategic moments, we should, as a species, feel greatly humbled.”

Wir bauen Systeme, die mächtig, aber nicht weise sind. Das ist kein Grund aufzuhören. Es ist ein Grund, mit Sorgfalt vorzugehen.

Dieser Beitrag basiert auf Material aus einem Vortrag auf der PPW VIU Konferenz 2022 und einem unveröffentlichten Essay aus September 2017.

References

- Russell, Stuart and Norvig, Peter. (2010). Artificial Intelligence: A Modern Approach. Pearson.

- Lapuschkin, Sebastian and Wäldchen, Stephan and Binder, Alexander and Montavon, Grégoire and Samek, Wojciech and Müller, Klaus-Robert. (2019). Unmasking Clever Hans predictors and assessing what machines really learn. Nature Communications.

- Thaler, Richard H. and Sunstein, Cass R.. (2009). Nudge: Improving Decisions About Health, Wealth and Happiness. Penguin.

- Johnson, Eric J. and Goldstein, Daniel. (2003). Do Defaults Save Lives?. Science.

- Karras, Tero and Laine, Samuli and Aila, Timo. (2019). A Style-Based Generator Architecture for Generative Adversarial Networks. ↗